Rodolfo Guluarte Hale

Full-Stack Engineer

Traducción neuronal automática mediante aprendizaje conjunto de alineación y traducción

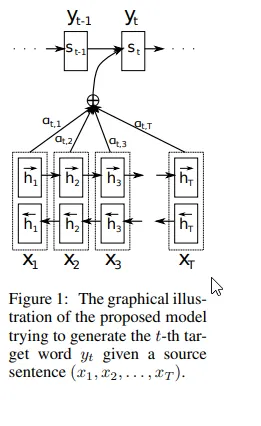

El artículo “Traducción automática neuronal mediante el aprendizaje conjunto de alineación y traducción” propone un enfoque reciente para la traducción automática conocido como traducción automática neuronal (NMT). A diferencia de la traducción automática estadística tradicional, NMT busca construir una única red neuronal que pueda ser ajustada conjuntamente para maximizar el rendimiento de la traducción. Los modelos propuestos para NMT a menudo pertenecen a una familia de codificadores-decodificadores y constan de un codificador que codifica una oración fuente en un vector de longitud fija a partir del cual un decodificador genera una traducción. Los autores del artículo plantean que el uso de un vector de longitud fija es un cuello de botella para mejorar el rendimiento de esta arquitectura básica codificador-decodificador y proponen extenderla permitiendo que el modelo busque automáticamente (suave-) partes de una oración fuente que sean relevantes para predecir una palabra objetivo, sin tener que formar explícitamente estas partes como un segmento duro. Con este nuevo enfoque, se logra un rendimiento de traducción comparable al del sistema basado en frases del estado del arte existente en la tarea de traducción de inglés a francés.

Lecciones aprendidas:

La traducción automática neuronal es un enfoque reciente para la traducción automática que busca construir una única red neuronal que pueda ser ajustada conjuntamente para maximizar el rendimiento de la traducción.

Los modelos propuestos para NMT a menudo pertenecen a una familia de codificadores-decodificadores y constan de un codificador que codifica una oración fuente en un vector de longitud fija a partir del cual un decodificador genera una traducción.

El uso de un vector de longitud fija es un cuello de botella para mejorar el rendimiento de la arquitectura básica codificador-decodificador.

Permitir que el modelo busque automáticamente partes relevantes de una oración fuente para predecir una palabra objetivo, sin tener que formar explícitamente estas partes como un segmento duro, puede mejorar significativamente el rendimiento de la traducción automática neuronal.

Referencias:

Bahdanau, D., Cho, K., & Bengio, Y. (2014). Neural machine translation by jointly learning to align and translate. arXiv preprint arXiv:1409.0473.